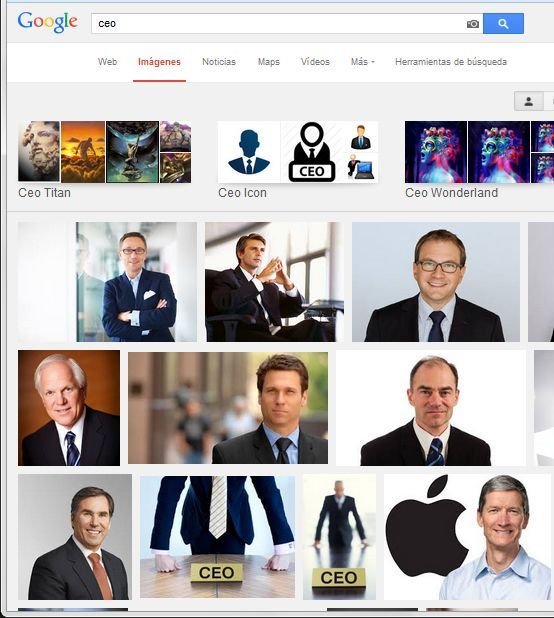

¿Qué pasa si introducimos el término «C.E.O.» en la búsqueda de imágenes de Google? Dos grupos de investigadores de las Universidades de Harvard y Washington parecen tenerlo claro: algunos algoritmos diseñados por las empresas punteras del sector de la tecnología, como Google o Microsoft, son discriminatorios.

Los resultados no reflejan fielmente la realidad, pero ¿Cómo es posible? Simplemente porque los algoritmos están diseñados y mantenidos por personas, y los sistemas de aprendizaje automático toman como base nuestra conducta. Un reflejo de la sociedad

El estudio que han realizado los investigadores de la Universidad de Harvard arroja un resultado similar al de la Universidad de Washington, aunque en un contexto diferente. En este caso han seleccionado un conjunto de nombres asociados mayoritariamente con personas de raza negra, otro conjunto utilizado con frecuencia por personas de raza blanca, y los han introducido en Google.

El resultado no podría ser más escabroso: al introducir un nombre como Jermaine o Darnell, habituales en personas negras, devuelve que la palabra «detención» aparece en entre el 81 y el 95% de las entradas. Y esta misma búsqueda pero con nombres como Emma o Geoffrey, que suelen identificar a personas blancas mayoritariamente, devuelve unos porcentajes que van del 23 al 60%.

Ninguno de los dos resultados refleja fielmente la realidad, y, sin embargo, existe la creencia generalizada de que los algoritmos informáticos son objetivos y precisos. ¿Cómo es posible que tergiversen de esta forma la realidad? Pues, sencillamente, porque los algoritmos están diseñados y mantenidos por personas, y los sistemas de aprendizaje automático toman como base nuestra conducta. Y esta estrategia, como acabamos de ver, no refleja de forma precisa el mundo real.

Por el momento la legislación que lucha contra la discriminación en los países industrializados, en los que Internet tiene unas raíces muy profundas, no se ha metido a fondo en este tema, pero es probable que en el futuro lo haga. Los investigadores que han realizado estos estudios defienden que Google, Microsoft y compañía deberían realizar simulaciones frecuentes para ver qué resultados devuelven sus algoritmos, y corregir estas desviaciones. Y la verdad es que no parece mala idea.

- España suspende en igualdad de género

- Más mujeres, mejores empresas

- ‘Las cuotas son poco populares pero un instrumento necesario’

- Becerra denuncia ante la UE la discriminación de género

- Equiparar los permisos para proteger a las trabajadoras

- Madres españolas: eficaces, improvisadoras y realizadas

- UNAF reivindica un entorno familiar libre de violencia

- ‘El Consejo vulnera los Tratados al bloquear la Directiva de baja por maternidad’

- AHIGE apoya la diversidad sexual, familiar y de género

- Fundación Endesa: Todos eran varones